Comment superviser Kubernetes avec ServicePilot ?

Introduction à la supervision de Kubernetes

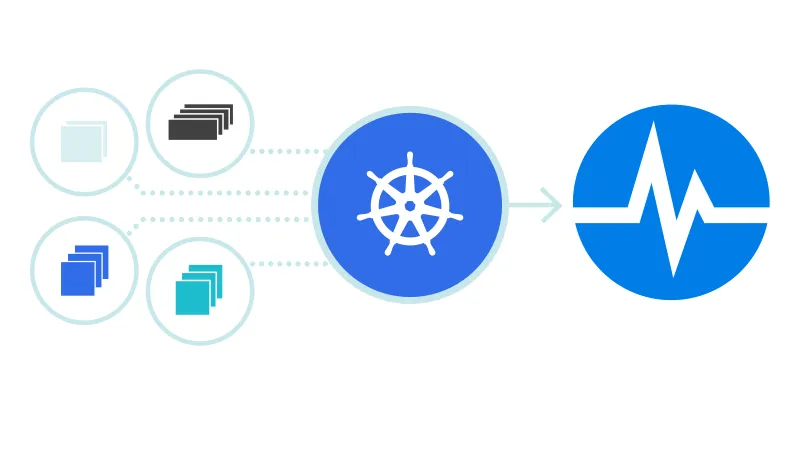

Kubernetes est devenu l’un des piliers des infrastructures modernes. En orchestrant des conteneurs à grande échelle, il permet aux entreprises de déployer et de gérer leurs applications avec une flexibilité remarquable. Cette puissance s’accompagne d’une complexité croissante : un cluster Kubernetes est un écosystème dynamique, composé de pods, de services, de nœuds et de multiples composants internes dont la santé doit être supervisée en permanence.

C’est précisément dans ce contexte que ServicePilot trouve toute sa valeur : une plateforme de supervision offrant une vision claire et centralisée de l’ensemble des métriques Kubernetes, tout en simplifiant la détection des anomalies et la gestion des incidents.

Avant de superviser un cluster Kubernetes, il est crucial de surveiller les ressources sous-jacentes : CPU, mémoire, disque et réseau. Les clusters Kubernetes sont des systèmes distribués complexes nécessitant des ressources adéquates pour assurer des performances élevées et une disponibilité maximale.

Pourquoi superviser Kubernetes ?

D’un point de vue opérationnel, superviser Kubernetes nécessite de comprendre une architecture fondée sur l’éphémérité des ressources, la variabilité des topologies, la superposition de couches d’abstraction et les interactions entre différents services, souvent non déterministes.

La supervision d’un cluster Kubernetes n’est donc pas une option, c’est une nécessité. Dans un environnement où les pods apparaissent et disparaissent en fonction de la charge, où les nœuds peuvent être saturés et où les services doivent rester accessibles en permanence, disposer d’une visibilité complète est indispensable.

Grâce à la supervision des clusters K8s, il devient possible de :

- Assurer la disponibilité en détectant rapidement les pods en erreur, les nœuds saturés ou les services indisponibles

- Optimiser les performances en comprenant l’utilisation de CPU, de la mémoire, du réseau et du stockage

- Anticiper les incidents en identifiant les tendances, en prévoyant les saturations et en ajustant les ressources

- Garantir la sécurité et la conformité en suivant les comportements anormaux, les pics d’activité ou les déploiements non prévus

Les défis sont nombreux. Kubernetes est un système distribué et dynamique avec des composants générant une grande variété de métriques. Corréler ces informations pour comprendre l’origine d’un incident peut rapidement devenir complexe.

ServicePilot répond à ces enjeux en centralisant les données, en les structurant et en les présentant de manière intelligible. Identifier les comportements anormaux et comprendre ce qui se passe réellement dans le cluster est plus simple grâce à :

- Une découverte automatique du cluster

- Une collecte automatique des métriques Kubernetes

- Des tableaux de bord préconfigurés pour nœuds, pods et services

- Un moteur d’alerting intelligent

- Une intégration avec les environnements DevOps

Monitoring des nœuds, des pods et des services

L’un des premiers atouts de ServicePilot est son tableau de bord général, qui offre une vision synthétique de l’état du cluster. En un coup d’œil, il est possible de voir quels pods fonctionnent correctement, lesquels rencontrent des erreurs, quels services sont disponibles et comment se comportent les nœuds. Les états sont clairement mis en évidence, ce qui facilite la détection immédiate des anomalies.

Chaque ressource bénéficie ensuite d’une vue détaillée. Pour les nœuds, ils sont analysés sous l’angle de la charge, de la saturation et de la disponibilité. Quant aux pods, ServicePilot affiche leur état, leur nombre de redémarrages, leur consommation CPU et mémoire. Les services disposent d’indicateurs sur leur accessibilité et leur latence. Cette granularité permet de comprendre précisément où se situent les points de tension.

Il est très facile de créer des widgets et des tableaux de bord personnalisés pour suivre les métriques de performances :

- CPU : utilisation par nœud, par pod, par namespace

- Mémoire : consommation, limites, risques d’OOMKill

- I/O : accès disque, latence, saturation

- Réseau : trafic entrant/sortant, erreurs, goulots d’étranglement

Exemples de widgets personnalisés :

- Courbes Top CPU par nœud

- Heatmap de la mémoire par pod

- Graphiques de latence réseau

- Histogrammes des redémarrages de pods

Au-delà de l’infrastructure, ServicePilot permet de suivre la performance réelle des applications et des workloads :

- Temps de réponse

- Taux d’erreur

- Saturation

- Dépendances entre services

Les équipes peuvent ainsi corréler un incident applicatif avec un problème d’infrastructure ou de configuration.

Gestion des incidents et alertes

La gestion des alertes est un élément central de la supervision. Avec ServicePilot, il est possible de définir différents types d’alertes selon les besoins : par exemple, un administrateur peut être averti lorsqu’un pod redémarre trop souvent, lorsqu’un nœud dépasse un certain niveau de charge ou lorsqu’un service devient inaccessible.

Voici plusieurs types d’alertes disponibles dans ServicePilot :

- Alertes de seuil : CPU, mémoire, réseau

- Alertes d’état : pod en erreur, nœud indisponible, service non accessible

- Alertes comportementales : anomalies détectées par IA

En plus des seuils pré-intégrés, il est aussi possible de configurer des alertes personnalisées basées sur ces indicateurs, qu’il s’agisse de seuils simples ou de tendances plus complexes.

Lorsqu’un incident survient, ServicePilot ne se contente pas de le signaler. La plateforme le classe selon sa criticité, rassemble les informations pertinentes et propose une analyse permettant de comprendre l’origine du problème.

Intégration avec d’autres outils

Dans un environnement DevOps, la supervision ne peut pas être isolée. Les Webhooks de ServicePilot permettent de s’intégrer naturellement avec les outils les plus courants, comme GitHub, GitLab, Jenkins, Slack ou Microsoft Teams. Ces intégrations contribuent à relier les alertes aux pipelines CI/CD, d’envoyer des notifications en temps réel ou encore d’automatiser certaines actions.

Grâce à ces connexions, il devient possible de déclencher des tests de performance après un déploiement, de suspendre un pipeline en cas d’incident ou de créer automatiquement des tickets dans un outil de gestion. Cette automatisation renforce la réactivité des équipes et contribue à une meilleure stabilité des environnements Kubernetes.

Cas d’usage concrets

1. Détection d’un problème de scheduling

Un des incidents les plus fréquents dans un cluster Kubernetes concerne l’impossibilité pour le scheduler d’attribuer un nœud à un pod. Ce type de problème se manifeste généralement par :

- Pods en état Pending qui ne passent jamais en Running

- Événements FailedScheduling indiquant que Kubernetes n’a trouvé aucun nœud compatible

- Pression CPU sur un ou plusieurs nœuds (Node CPU pressure) qui empêche la planification de nouvelles charges

Grâce à la supervision, l’équipe peut rapidement corréler ces signaux : un pic de consommation CPU sur un pool de nœuds, suivi d’une montée du nombre de Pods Pending, est un pattern classique de saturation.

Recommandation opérationnelle avec deux leviers généralement efficaces :

- Ajuster les requests/limits pour éviter une sur‑allocation artificielle des ressources

- Ajouter un nœud au cluster ou au nœud pool concerné pour absorber la charge réelle

Une plateforme comme ServicePilot permet de visualiser en un coup d’œil la pression sur les ressources et les événements associés, ce qui accélère considérablement le diagnostic.

2. CrashLoopBackOff récurrent

Le statut CrashLoopBackOff est un autre grand classique. Il indique qu’un conteneur démarre, tombe, redémarre… et ainsi de suite. Pour comprendre la cause, plusieurs sources d’observabilité sont essentielles :

- Logs du conteneur : par exemple une NullPointerException répétée

- Événements OOMKilled montrant que le conteneur dépasse sa limite mémoire

- Métriques de consommation mémoire révélant que la memory limit est trop basse par rapport au comportement réel de l’application

La corrélation entre logs applicatives, événements du kubelet et métriques de ressources permet d’identifier rapidement si le problème est logiciel (bug) ou infrastructure (limites trop strictes).

Dans le cas d’un OOM, la résolution passe par :

- Ajuster les limites mémoire pour refléter les besoins réels

- Éventuellement optimiser l’application si la consommation est anormale

La supervision centralisée facilite cette analyse en regroupant logs, métriques et événements dans un même contexte.

3. Dégradation de performance applicative

Les problèmes de performance dans un environnement microservices sont souvent complexes, car ils impliquent plusieurs couches : application, réseau, dépendances externes, stockage… Une supervision complète permet d’identifier :

- Une latence P99 élevée, signe d’un ralentissement affectant la majorité des requêtes

- La saturation d’un microservice, visible via le taux de requêtes, l'utilisation de CPU ou la file d’attente

- Des traces distribuées mettant en évidence un goulot d’étranglement, par exemple une base de données externe qui répond lentement

- Une cartographie de dépendances révélant qu’un service critique est impacté et propage la latence à toute la chaîne

Ce type d’analyse est particulièrement difficile sans observabilité distribuée. Les traces permettent de remonter précisément au composant fautif, tandis que les métriques confirment la saturation.

L’équipe peut ainsi prioriser les actions : augmenter les ressources d’un service, optimiser une requête SQL, mettre en cache une dépendance externe, etc.

4. Problème réseau intra‑cluster

Les incidents réseau internes au cluster sont souvent sous‑estimés, alors qu’ils peuvent provoquer des comportements erratiques dans les microservices. Les symptômes typiques incluent :

- Erreurs TCP (retransmissions, resets) entre services

- Latence inter‑pods anormalement élevée

- Node network pressure indiquant que l’interface réseau du nœud est saturée

- Visualisation des flux impactés montrant quels services ne parviennent plus à communiquer correctement

Une supervision réseau intégrée au niveau Kubernetes permet de détecter rapidement si le problème vient d’un nœud, d’un CNI défaillant, d’un goulot d’étranglement sur un lien ou d’un service qui génère un trafic anormal.

Sans cette visibilité, les équipes perdent un temps précieux à suspecter l’application alors que la cause est purement réseau.

Une vision unifiée pour les équipes DevOps, SRE et IT

L’un des grands avantages de ServicePilot est sa capacité à rassembler toutes les données Kubernetes dans une seule plateforme :

- Vue d’ensemble du cluster

- Analyse détaillée des workloads

- Cartographie dynamique des services

Cette approche réduit drastiquement le temps moyen de résolution (MTTR) et améliore la fiabilité globale des environnements Kubernetes.

K8s est puissant, mais sa complexité nécessite une supervision moderne, capable de suivre des environnements dynamiques et distribués. Avec ServicePilot, les équipes disposent d’une plateforme unifiée pour surveiller, diagnostiquer et optimiser leurs clusters et workloads.

Résultat : moins d’incidents, une meilleure performance applicative et une exploitation plus sereine de Kubernetes.